Au même moment où Trump centralise la régulation IA aux USA, l’UE envisage d’assouplir l’AI Act. Deux approches différentes, un objectif commun : prioriser la compétitivité sur une régulation stricte.

Points Clés à Retenir

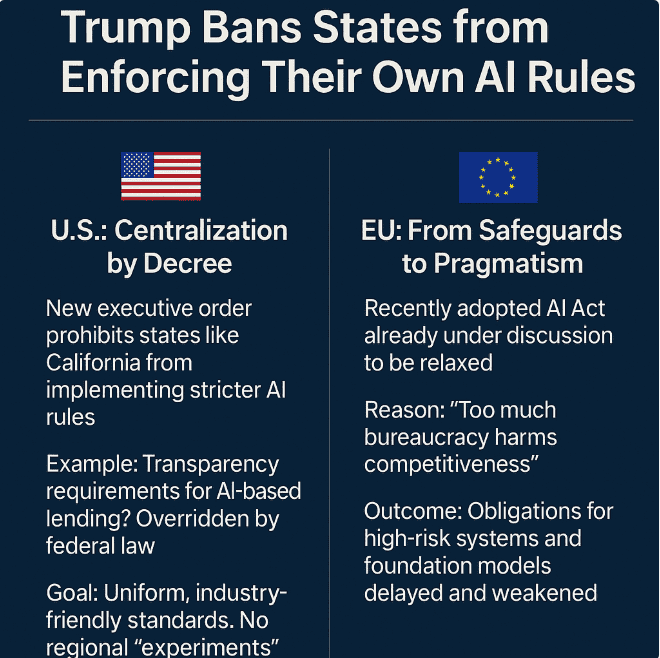

- USA : Centralisation fédérale : Le décret du 11 décembre 2025 empêche les États d’imposer des règles IA plus strictes que le standard fédéral.

- UE : Assouplissement de l’AI Act : Reports de deadlines jusqu’en 2027 et réduction des charges administratives via le Digital Omnibus.

- Enjeu stratégique : Celui qui fixe les règles pour l’IA définit l’infrastructure du savoir et de l’économie pour 20 ans.

- Risques concrets : Standards divergents, moindre transparence et droits de recours réduits pour les citoyens.

Hasard ? Non. Deux approches différentes, mais un objectif commun : prioriser la compétitivité sur une régulation stricte. Décryptage de deux mouvements réglementaires majeurs qui redéfinissent le paysage mondial de l’intelligence artificielle.

USA : Centralisation par décret présidentiel

Le décret exécutif signé le 11 décembre 2025 vise à établir un cadre national unique pour l’IA, en limitant les régulations plus strictes au niveau des États fédérés (comme en Californie ou au Colorado).

Concrètement :

- Les États ne pourront plus imposer de règles plus contraignantes que le standard fédéral.

- Exemple : Les obligations de transparence pour les décisions de crédit assistées par IA pourraient être uniformisées au niveau fédéral, potentiellement moins protectrices qu’au niveau local.

Objectif déclaré : Éviter une fragmentation réglementaire qui freinerait l’innovation et la scalabilité des entreprises américaines face à la concurrence chinoise et européenne.

UE : Du rigorisme initial au pragmatisme

À Bruxelles, la Commission européenne a proposé en novembre 2025, via le “Digital Omnibus”, des amendments à l’AI Act pour simplifier son application : reports de deadlines (jusqu’en 2027 pour certains systèmes à haut risque), réduction de charges administratives et allègement pour favoriser la compétitivité.

Raisons invoquées : Trop de bureaucratie risque de pénaliser les entreprises européennes face aux USA et à la Chine.

Concrètement :

- Délais étendus pour les obligations sur les systèmes à haut risque et les modèles de fondation.

- Simplification des reporting et des évaluations de conformité.

- Allègement des contraintes pour les PME et startups européennes.

Ce que cela signifie en pratique

Pour les entreprises : Standards divergents entre marchés US et UE. Les acteurs globaux devront adapter leurs développements à deux (ou plus) cadres réglementaires – doublant efforts et coûts de mise en conformité.

Pour les citoyens : Risque de moindre transparence et de droits de recours réduits face aux décisions automatisées (crédit, recrutement, assurances, services publics).

Pour les développeurs : La priorité passe de “Quelle IA éthique construisons-nous ?” à “Pour quel marché optimisons-nous – et quels safeguards acceptons-nous de sacrifier ?”

L’enjeu fondamental

Celui qui fixe aujourd’hui les règles pour les modèles à usage général et les systèmes agents définit l’infrastructure du savoir et de l’économie pour les 20 prochaines années.

- USA : Pari sur une scalabilité maximale avec une fragmentation minimale.

- UE : Tentative d’équilibre entre protection des droits fondamentaux et compétitivité – avec le risque d’être prise en tenaille.

Comment l’Europe peut réussir l’équilibre

Cela reste possible, mais exige trois priorités claires :

- ✅ Différenciation basée sur les risques – Éviter les règles blanket pour tous les chatbots ou modèles de fondation.

- ✅ Cadres de gouvernance flexibles – Plutôt qu’une micro-régulation impraticable.

- ✅ Investissements massifs en compétences IA – Dans les entreprises, les autorités et la société civile. Sans cela, toute régulation reste théorique.

Sinon ? La promesse de protection se transforme en frein bureaucratique, sans innovation ni safeguards réels.

Trois questions à la communauté

1️⃣ Ressentez-vous déjà, dans vos entreprises, les impacts concrets de ces divergences réglementaires USA vs. UE ?

2️⃣ Où l’AI Act (ou son assouplissement potentiel) freine-t-il l’innovation – et où reste-t-il une protection indispensable ?

3️⃣ À quoi devrait ressembler une régulation “pragmatique” : ni diluée ni asphyxiante ?

Conclusion

Nous assistons à un tournant historique dans la régulation de l’IA. Entre centralisation américaine et pragmatisme européen, les choix d’aujourd’hui définiront l’équilibre entre innovation, compétitivité et protection des droits fondamentaux pour les décennies à venir.

Date : 18 décembre 2025 – Cet article reflète l’état actuel des discussions réglementaires, en évolution rapide.

📌 Sources : White House (Executive Order du 11 déc. 2025), Tagesschau.de, Euronews, Commission européenne (Digital Omnibus), Banking.Vision, Politico, NPR, Fortune.